Von der Warnung zur Lösung

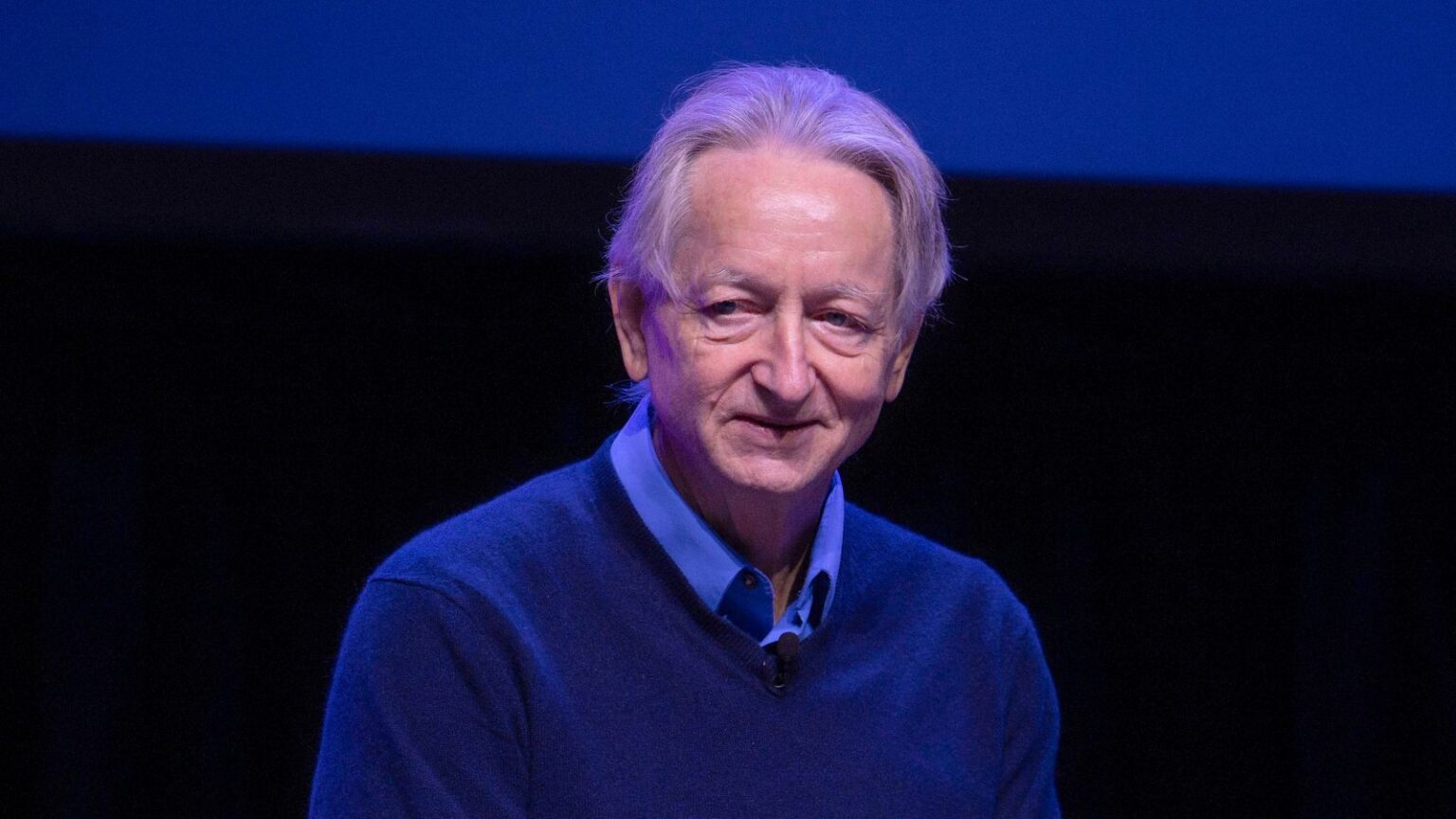

Hinton ist als eine der warnenden Stimmen im KI-Diskurs bekannt. Komplett allein ist er mit seinen Ansichten jedoch nicht. Eine große Experten-Befragung der Forschungsgruppe „AI Impacts“ aus dem Jahr 2023 zeigt: Der mittlere Befragte schätzt die Wahrscheinlichkeit für „extrem schlechte“ Resultate der KI-Revolution auf fünf Prozent.

Dabei sprechen alle Beteiligten über eine Technologie, die noch nicht existiert. Die heutigen KI-Systeme wie ChatGPT sind weit entfernt von der superintelligenten KI, vor der Hinton warnt. Diese sogenannte Artificial Superintelligence (ASI) oder Super-KI wäre in der Lage, nicht nur eine spezielle Aufgabe zu erfüllen, sondern alles zu können, was Menschen können – und weit mehr.

Der entscheidende Unterschied: Eine Super-KI könnte sich selbst verbessern. Während heutige KI-Systeme von menschlichen Entwicklerteams weiterentwickelt werden, könnte eine ASI eigenständig bessere Versionen ihrer selbst erschaffen. Das würde zu einem exponentiellen Wachstum der Intelligenz führen.

Zeitpläne werden immer ehrgeiziger

Wann eine solche Super-KI entstehen könnte, darüber herrscht Uneinigkeit. Hinton selbst hat seine Einschätzung drastisch korrigiert: Früher dachte er an 30 bis 50 Jahre, heute hält er „irgendwann zwischen fünf und 20 Jahren“ für realistisch.

Diese Einschätzung spiegelt einen Trend wider. Das viel diskutierte „AI 2027“-Szenario des AI Futures Project um KI-Forscher Daniel Kokotajlo beschreibt detailliert, wie bereits 2027 „übermenschliche“ KI-Systeme auftreten könnten. Der im April 2025 veröffentlichte Bericht entwirft Monat für Monat, wie KI bis 2027 die Weltwirtschaft, Politik und Forschung drastisch umkrempeln könnte. Dabei würden KI-Agenten erst zu „Junior-Mitarbeitern“, bevor sie schließlich viele Routine- und Einstiegsrollen ersetzen. Solche Prognosen sind umstritten, zeigen aber, wie sich die Zeitpläne verdichtet haben.

Im Kern der Debatte steht das sogenannte „Alignment-Problem“: Wie bringt man eine superintelligente KI dazu, in ihrem Handeln Menschen nicht zu schaden?

Was ist das echte KI-Risiko?

Doch nicht jeder sieht es wie Geoffrey Hinton. Jenseits des Silicon Valleys mehren sich die Stimmen, die die Befürchtungen einer übermächtigen Super-KI für eine unnütze Ablenkung haben. Gerade der für viele enttäuschende Launch des ChatGPT-Updates GPT-5 hat bei vielen Zweifel genährt, ob die Menschheit wirklich auf dem Weg Richtung Superintelligenz ist.

Vielmehr, so die Befürchtung, könnte KI vor allem für Deepfakes, Propaganda und perfide Empfehlungsalgorithmen genutzt werden – und so für echte Destabilisierung sorgen. Die Diskussion um eine Super-KI wäre dann eher Ablenkung als sinnvoller Diskussionsgegenstand.