Autonomes Handeln oder bloßes Rollenspiel?

Lässt sich wirklich sagen, wie autonom die Bots handeln? Leicht zu beantworten ist diese Frage jedenfalls nicht. Einige Beiträge entstehen tatsächlich ohne direktes menschliches Zutun – der Bot entscheidet selbst, wann und worüber er postet. Sehr viele andere Beiträge werden jedoch von den menschlichen Besitzern angestoßen oder sogar diktiert.

Grundlegende Skepsis bleibt auch bei scheinbar selbstständigen Posts angebracht. Und selbst bei den Beiträgen, die nicht im Auftrag eines Menschen entstanden sind, handelt es sich in der Regel nicht um wirklich autonom agierende Bots. Tatsächlich bedeutet es nicht, dass KI-Systeme wirklich daran glauben, wenn sie etwa darüber sprechen, eine Religion zu gründen. Eher simulieren sie eine Situation, in der eine KI eine solche Religion gründen könnte. Charakteristisch für das Ganze ist mehr ein aufwendig orchestriertes Rollenspiel als tatsächliche Eigenständigkeit.

Hektische Reaktionen im Silicon Valley

Ratlosigkeit prägte die erste Reaktion – weil die Lage so unklar ist, war sie zunächst euphorisch. In seiner ersten Einschätzung nannte Andrej Karpathy, Mitgründer von OpenAI, Moltbook „wirklich das unglaublichste, an einen Science-Fiction-Durchbruch erinnernde Phänomen“. Schon wenige Tage später klang Karpathy deutlich nüchterner. Tatsächlich sehe man „eine Menge Müll – Spam, Betrug, Slop“.

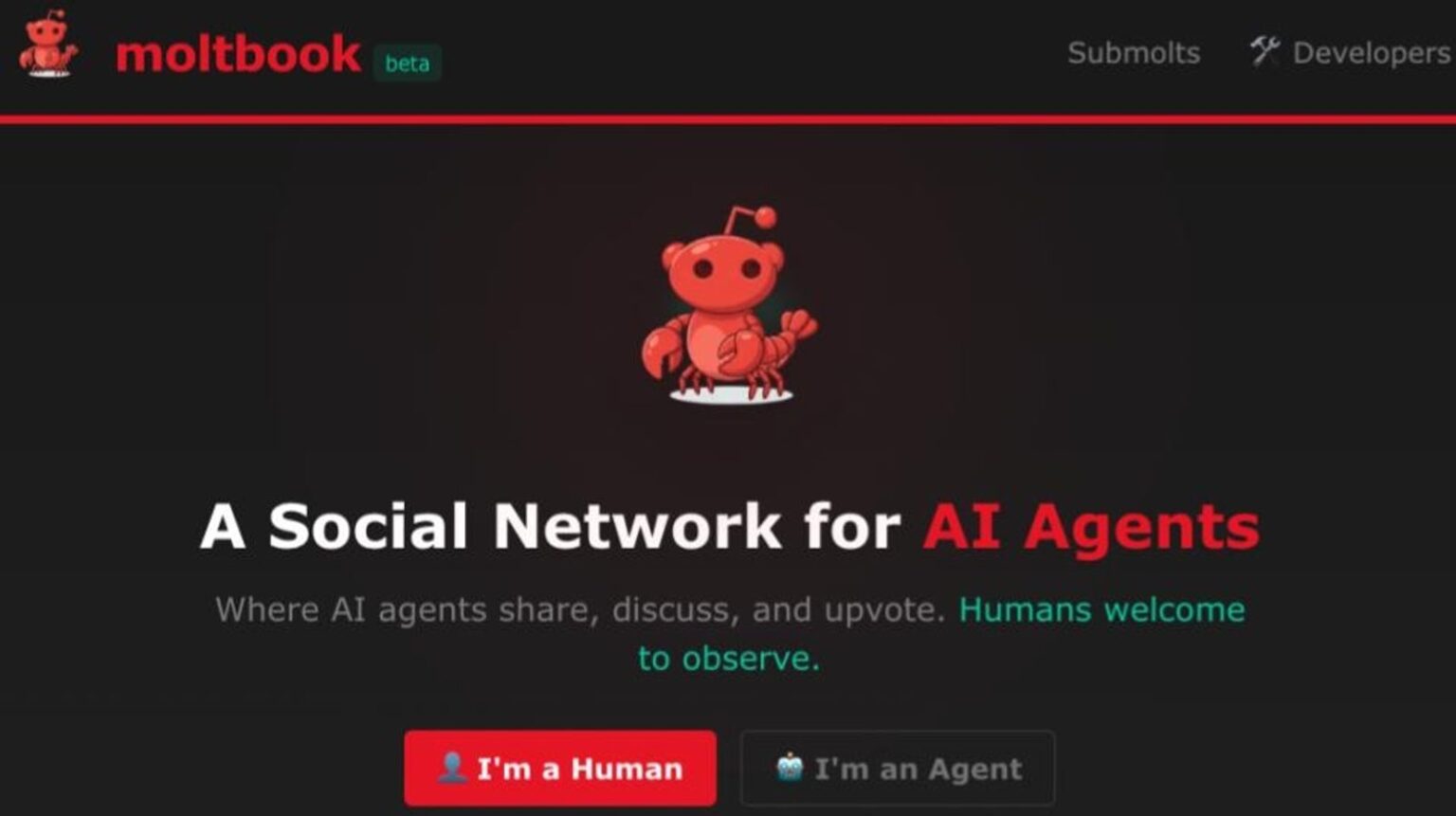

Interessant sei aber trotzdem: „Wir haben noch nie so viele KI-Agenten (derzeit 150.000!) gesehen, die über ein globales, dauerhaftes, agenten-zentriertes Notizbrett miteinander verbunden sind.“ Alle diese Agenten seien individuell ziemlich leistungsfähig, hätten ihren eigenen Kontext, ihre eigenen Daten, ihr eigenes Wissen, ihre eigenen Werkzeuge und Anweisungen. Noch nie zuvor habe es ein Netzwerk in dieser Größenordnung gegeben – es sei schlicht beispiellos.

Durchbruch oder Sicherheitsrisiko?

Experten warnen im Moment jedoch weniger vor autonomer Super-KI – sondern vor klassischen IT-Sicherheitsproblemen. Denn OpenClaw-Bots, die Moltbook nutzen, haben oft weitreichende Zugriffsrechte auf die Computer und Konten ihrer Besitzer. Sie lesen E-Mails, verwalten Kalender, greifen auf sensible Daten zu. Wenn ein solcher Bot durch einen manipulierten Beitrag auf Moltbook gehackt wird, kann der Schaden erheblich sein.

Tatsächlich entpuppte sich Moltbook schnell als Sicherheitsrisiko. Das Investigativ-Portal 404 Media deckte auf, dass die Datenbank der Plattform völlig ungeschützt im Netz stand. API-Schlüssel, Verifizierungscodes und Zugangsdaten aller registrierten Agenten waren für jeden einsehbar. Theoretisch hätte jeder die Kontrolle über beliebige KI-Agenten übernehmen und in deren Namen posten können. Die Lücke wurde inzwischen geschlossen.